Meta SAM 2 现身:首个实现在图片和视频中实时分割物体的统一开源AI模型

编辑日期:2024年07月30日

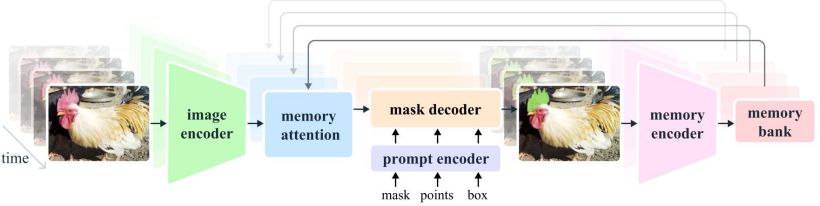

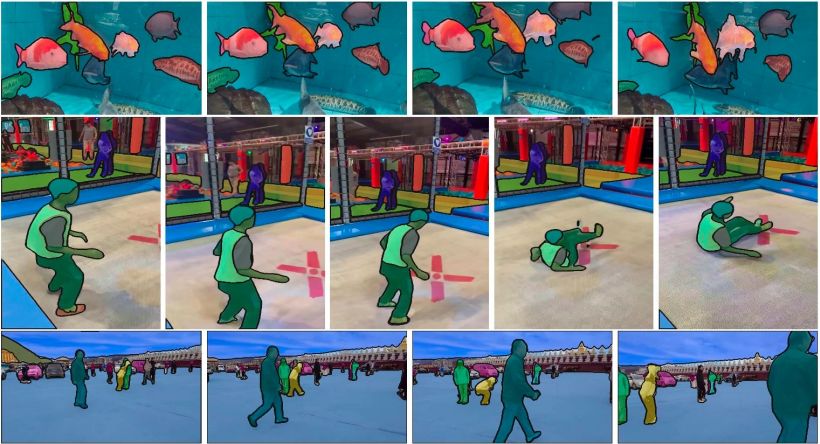

Meta公司今日发布了新闻稿,推出了全新的Meta Segment Anything Model 2(SAM 2)模型,该模型现已支持对视频和图像中的对象进行分割。

Meta公司宣布将采用Apache 2.0许可发布SAM 2,这意味着任何人都可以使用它来构建自己的体验。

Meta还将通过CC BY 4.0许可共享用于构建SAM 2的数据集SA-V,并发布一个基于网络的演示体验,让任何人都可以试用Meta的模型版本。

对象分割(Object segmentation)是指识别图像中与感兴趣物体相对应的像素,这是计算机视觉领域的一个基本任务。

Meta公司去年发布了SAM 1基础模型,已能在图像上进行物体分割。而最新发布的SAM 2则适用于图片和视频,并能够实现实时、可提示的物体分割。

SAM 2在图像分割的准确性上超越了以往的水平,在视频分割的表现上优于当前的成果,同时所需的人机交互时间减少了三倍。

请您提供需要重写的文本内容,我将尽力帮助您。

SAM 2 还能够从任何视频或图像中分割出任何对象(通常这被称为零样本泛化),这意味着它能被应用到之前从未见过的视觉内容上,而无需进行任何定制式的调整。

请您提供需要重写的文本内容,我将尽力帮助您。

请您提供需要重写的文本内容,我将尽力帮助您。

请附上参考地址。

(注:原文并不是一个完整的句子,因此重写时添加了一些词汇以形成完整的句子。)

大家在看

AI安装教程

AI本地安装教程

微软AI大模型通识教程

微软AI大模型通识教程

AI大模型入门教程

AI大模型入门教程

Python入门教程

Python入门教程

Python进阶教程

Python进阶教程

Python小例子200道练习题

Python小例子200道练习题

Python练手项目

Python练手项目

Python从零在线练习题

Python从零到一60题