阿里通义千问推出Qwen2-VL:一款开源的2B/7B参数AI大模型,能够处理任意分辨率的图像,无需将其分割成块。

编辑日期:2024年08月30日

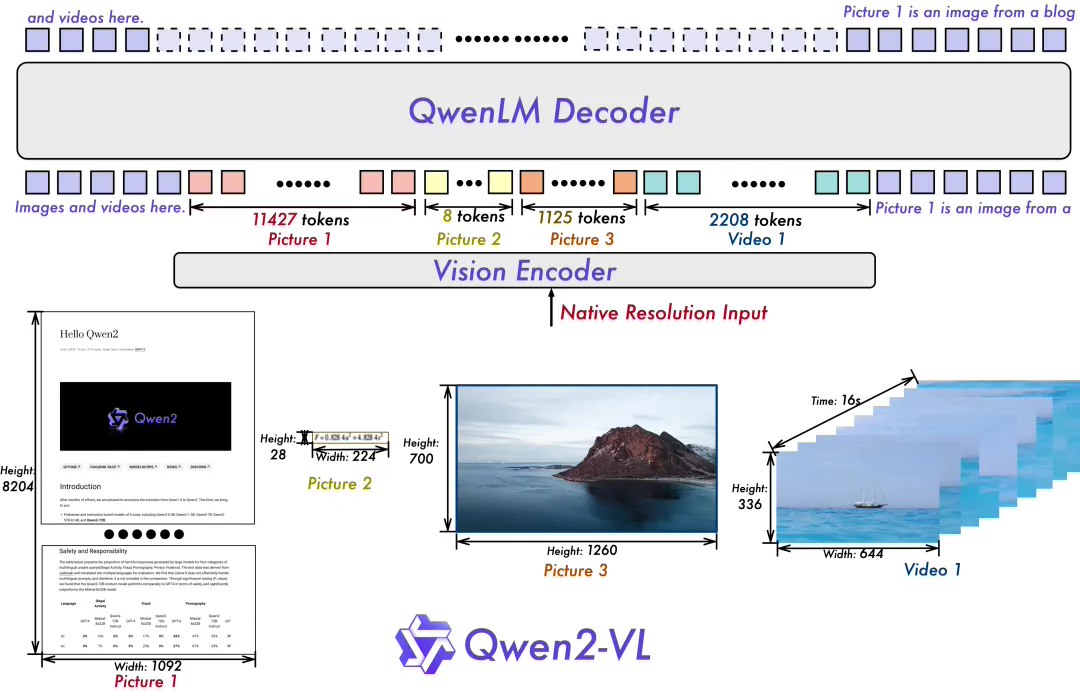

Qwen2-VL 的一项关键架构改进是实现了动态分辨率支持(Naive Dynamic Resolution support)。与前代模型 Qwen-VL 相比,Qwen2-VL 能够处理任意分辨率的图像,无需将图像分割成块,从而确保模型输入与图像固有信息的一致性。这种方法更贴近人类的视觉感知方式,使模型能够处理任何清晰度和大小的图像。

另一个关键的架构增强是多模态旋转位置嵌入(M-ROPE)。通过将原始的旋转嵌入分解为三个部分,分别代表时间信息和空间信息(高度与宽度),M-ROPE 使得大型语言模型能够同时捕捉并整合一维文本、二维视觉和三维视频的位置信息。这使得大型语言模型能够充当多模态的处理器和推理器。

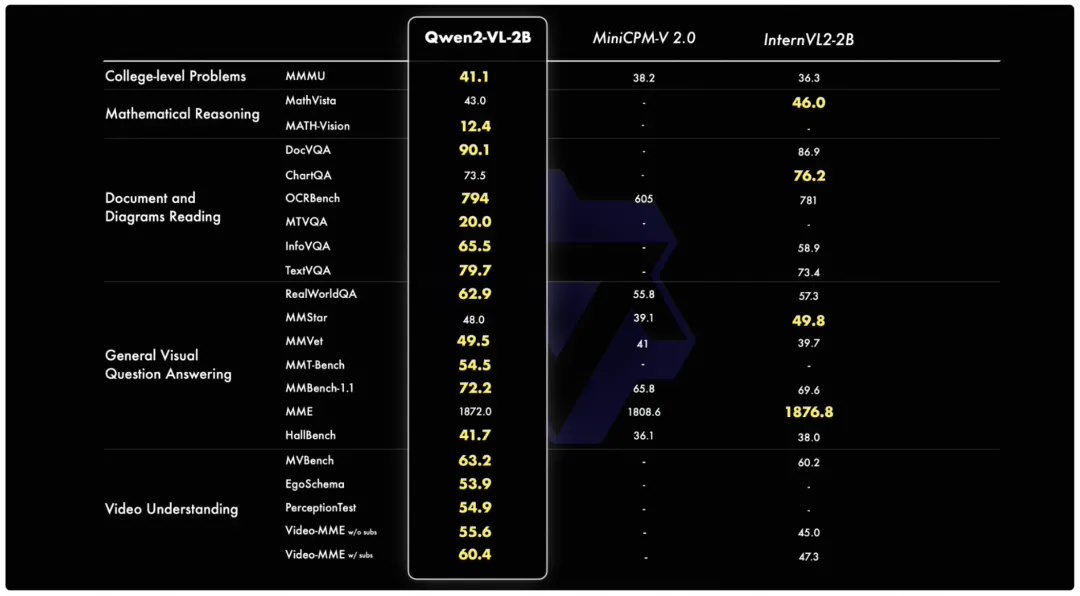

在7B参数规模下,Qwen2-VL-7B 保留了对图像、多图像和视频输入的支持,以更经济的模型大小提供了“具有竞争力”的性能。

Qwen2-VL-2B 模型已经针对潜在的移动部署进行了优化。虽然该模型的参数量仅为 2B,但官方表示其在图像、视频和多语言理解方面的表现非常出色。

附上模型链接如下: