中国科学院研发出一种基于语义记忆的动态神经网络:相较于静态模型,计算量最高可减少48.1%。

编辑日期:2024年09月02日

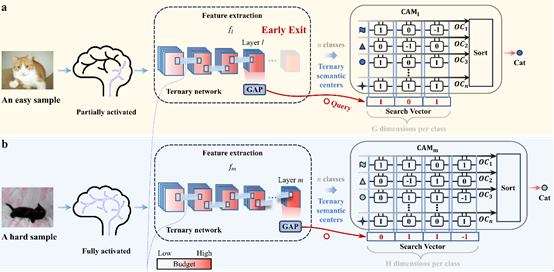

大脑神经网络拥有复杂的语义记忆和动态连通性,能够将不断变化的输入与庞大的记忆中的经验关联起来,从而高效地执行复杂多变的任务。

目前,广泛应用于人工智能系统中的神经网络模型大多是静态的。随着数据量的不断增加,这种模型在传统数字计算系统中导致了大量的能耗和时间开销,并且难以适应外部环境的变化。

与静态网络相比,语义记忆动态神经网络能够根据计算资源的权衡来调整识别准确性和计算效率,在资源受限的设备或分布式计算环境中表现出优异的性能。

据了解,在对2D图像数据集MNIST和3D点云数据集ModelNet的分类任务中,该设计实现了与软件相当的准确率,相较于静态神经网络,其计算量分别减少了48.1%和15.9%,并且相较于传统的数字硬件系统,其计算能耗也有所降低。