三星高管透露GPT-5详情:拥有3-5万亿参数,使用7000块B100进行训练

编辑日期:2024年09月07日

OpenAI:有许多重要信息要与您分享

GPT-5拥有3-5万亿参数,由7000块B100训练而成?!

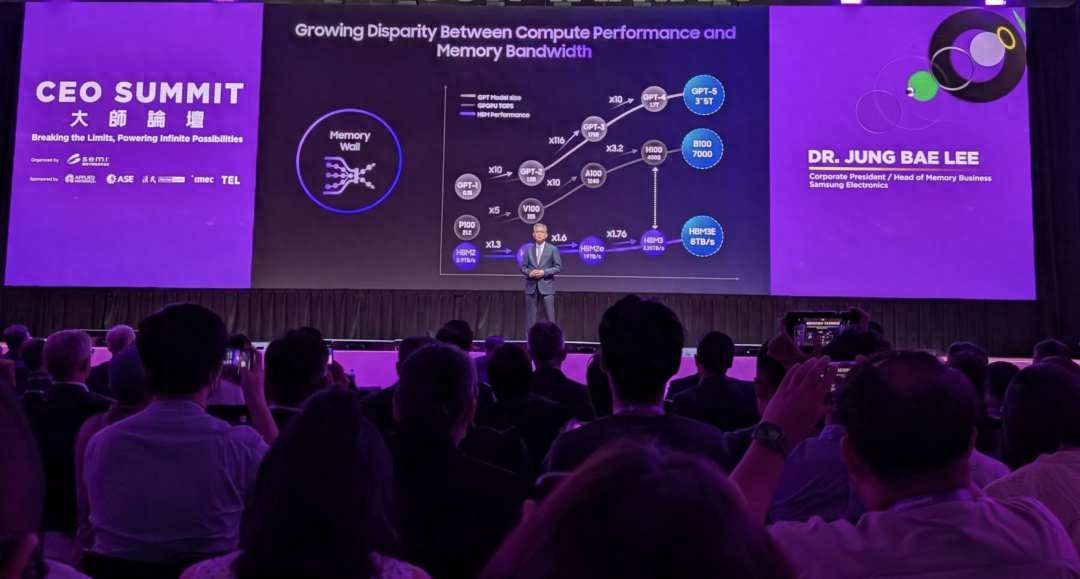

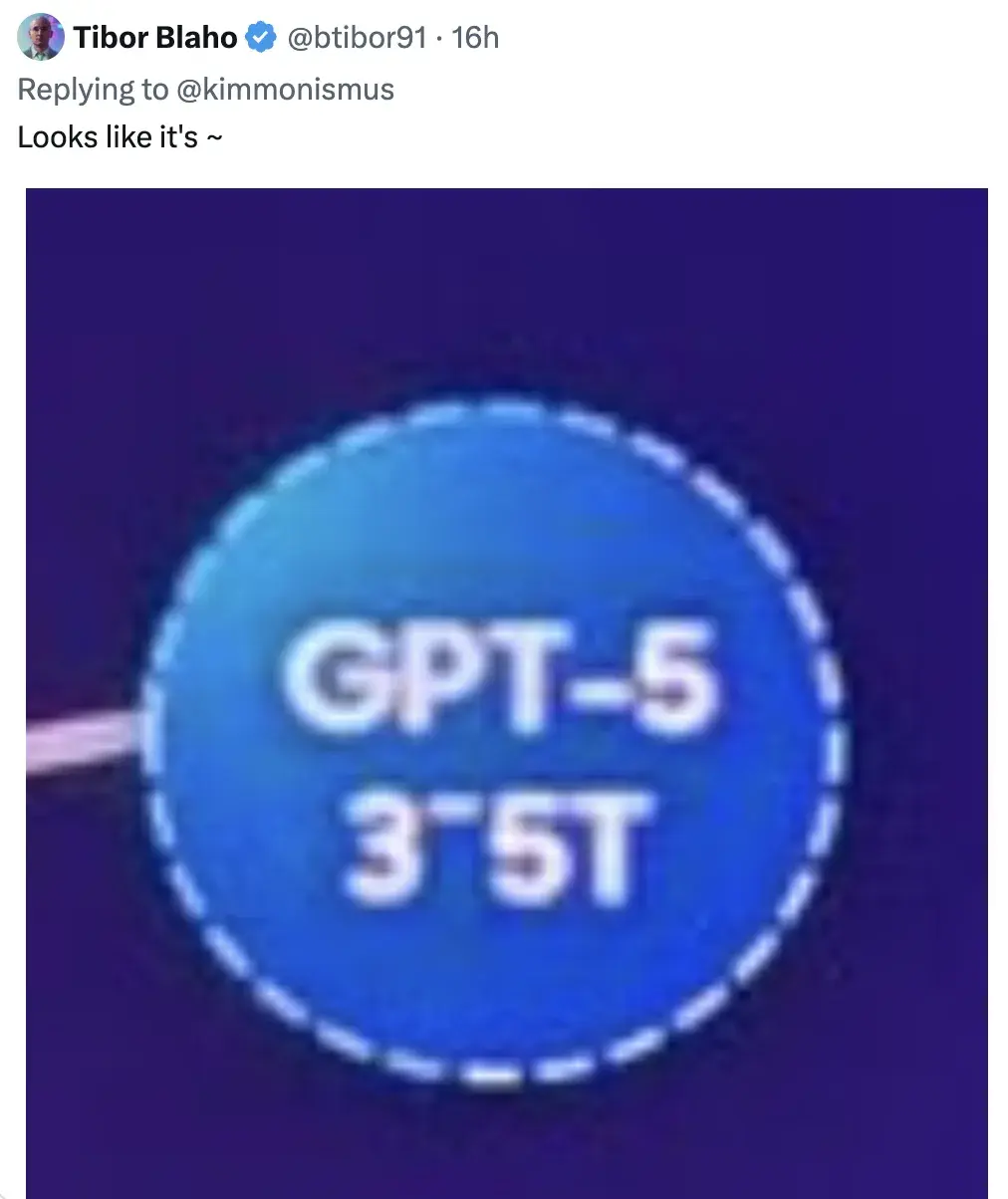

一夜之间,下图在网络上广泛传播:

仔细观察,这是三星高管Jung Bae Lee(李祯培)在一高级管理层峰会上的演讲内容。

图片中清晰地写着GPT-5的参数数量为3-5万亿(3-5T)、使用了7000块B100显卡以及每秒8TB的HBM3E内存带宽。

网友还发现,不仅三星高管有所“剧透”,OpenAI日本办事处负责人Tadao Nagasaki在其最新演讲中也展示了类似的内容:

图片显示,今年即将推出的“GPT Next”模型性能将是GPT-4的100倍。

巧合的是,微软CTO Kevin Scott在今年早些时候也展示过类似的图表:

这些信息拼凑在一起后,网友们纷纷热议,表示迫不及待想看到新的进展。

除了上述PPT外,还有网友从OpenAI相关域名更新中发现了新的线索。

就在昨天,有更新内容中出现了“staging”(cdn.staging.openai.com)字样,引发了网友们的猜测,认为这可能是为了测试接近实际生产环境的配置。

进一步观察发现,8月29日似乎出现了一个与“video”相关的域名,难道是Sora吗?

与此同时,OpenAI也有了新的动作。他们并没有进行澄清,而是表示有许多重要的信息要公布,并为此开设了一个新的官方账号——OpenAI Newsroom。

结合之前的草莓和猎户座的爆料,最近关于OpenAI即将发布新模型的消息越来越多,网友们纷纷猜测GPT-5真的要来了。

有网友分析称:

2到3倍的性能提升意味着:采用了新的架构,能够在不增加计算资源的情况下实现能力的指数级增长;同时表明大型语言模型(LLM)已经趋于成熟。

然而,除了期待之外,也有不少网友表示希望这次不再是空穴来风,而是真正有所进展。

参考链接: 1. https://x.com/apples_jimmy/status/1831221448935100482 2. https://x.com/airesearch12/status/1831299302825562566 3. https://x.com/OpenAI/status/1831389360937431270 4. https://x.com/legit_rumors/status/1831391130988233073

图片说明:三星高管透露GPT-5详情:拥有3-5万

- 程序员感叹:已经跟不上AI的发展步伐了。

- 这一数字是去年全年的46倍。

- 内部文件被曝光。

- 他们还抱怨OpenAI没有给予访问权限。

- OpenAI的人才持续流向竞争对手Anthropic。