北京大学提出了首个通用指令导航大模型系统 | CoRL 24

编辑日期:2024年09月12日

机器人学会导航了!

想象一下,你躺在沙发上,只需简单地发出指令,机器人就能帮你完成各种任务,这听起来是不是很惬意?

如今,科幻电影中的这一场景正逐渐成为现实。近日,北京大学助理教授、博士生导师董豪团队提出了首个通用指令导航大模型系统——InstructNav。

不论是寻找物体、走到指定位置,还是满足抽象的人类需求,只要你发出指令,InstructNav 都能帮你实现。

目前,这项研究成果已被CoRL(Robot Learning Conference)2024会议录用,并且论文已在Arxiv上发布,代码也将于近期开源。

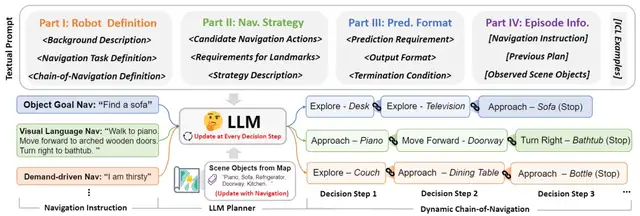

不同的导航任务对机器人的能力要求各不相同。经典的物体导航任务需要理解房间结构和物体之间的关系;视觉语言导航任务则侧重于精确执行指令;新兴的需求驱动导航任务则要求根据人类抽象需求进行语义推理。

以往的研究工作主要针对某种特定类型的指令设计特定的导航方法。然而,在实际应用中,人类可能会向机器人发出多种形式的指令,甚至是混合类型的指令。现有的具身导航模型无法满足这种需求,因此实现通用指令导航对于机器人在现实世界的应用具有重要意义。

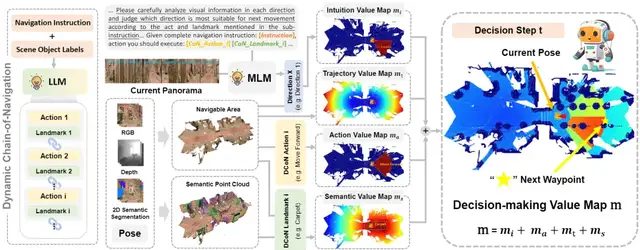

为了实现这一目标,作者提出了全新的导航规划范式——动态导航链路(Dynamic Chain-of-Navigation),将不同类型的导航指令统一为“导航动作 1 – 标志物1 -> 导航动作 2 – 标志物 2 …”的标准形式。

InstructNav 利用大语言模型在任务规划和常识推理方面的卓越能力,根据原始指令规划导航链路。

在导航过程中,InstructNav 会根据最新观测到的场景物体不断更新导航链路,从而引导机器人对环境进行有效探索。例如,当指令要求“寻找沙发”时,动态导航链路会被更新为“探索 — 电视”附近区域,因为沙发通常位于电视旁。

尽管大模型规划的动态导航链路与控制机器人底层动作之间仍存在差距,为了引导机器人按照动态导航链路行动,作者提出将大模型的规划结果映射到多源价值地图(Multi-sourced Value Maps)上。这些价值地图包括:

通过对多源价值地图求和可得到决策价值地图(Decision-making Value Map)。在决策价值地图上选择最高价值点作为下一途径点,然后利用点到点的路径规划算法即可实现对机器人底层移动的控制。

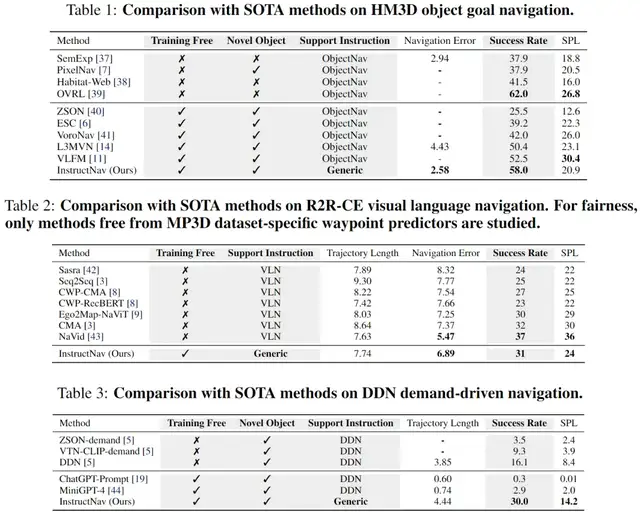

作者在经典的物体目标导航任务、视觉语言导航任务以及最新的需求导航任务上进行了标准化评测。从下表可以看出,InstructNav 首次实现了连续环境下零样本的视觉语言导航,并在零样本的物体目标导航和需求驱动导航任务上全面超越了所有现有方法,获得了最高的成功率。

文章链接:https://arxiv.org/pdf/2406.04882 项目链接:https://sites.google.com/view/instructnav 代码链接:https://github.com/LYX0501/InstructNav

北京大学提出了首个通用指令导航大模型系统

8月29日晚上8点,让我们共同探讨如何解决具身智能的数据难题。

北京大学推出的这一通用指令导航大模型系统,仅用3天时间就完成了含有130亿参数的视觉语言模型(VLM)训练。

该系统的推出,标志着在实现大型模型实际应用的关键路径上取得了重要进展。

其背后的公司已经成功融资近8000万美元。

对于这个消息,各校校友们的反应不一,有喜有忧。

此外,该系统还创造了处理40万文本的新纪录。

(注:图片链接未被包含在内,因为它们并未提供具体的上下文信息。)

大家在看