小心!AI能够“读懂”你的唇语,私密谈话不再安全!

编辑日期:2024年09月12日

AI:只需人类动动嘴皮子

小心悄悄话被AI听见!(嘘)

最近,国外一款能读唇语的AI软件火了!

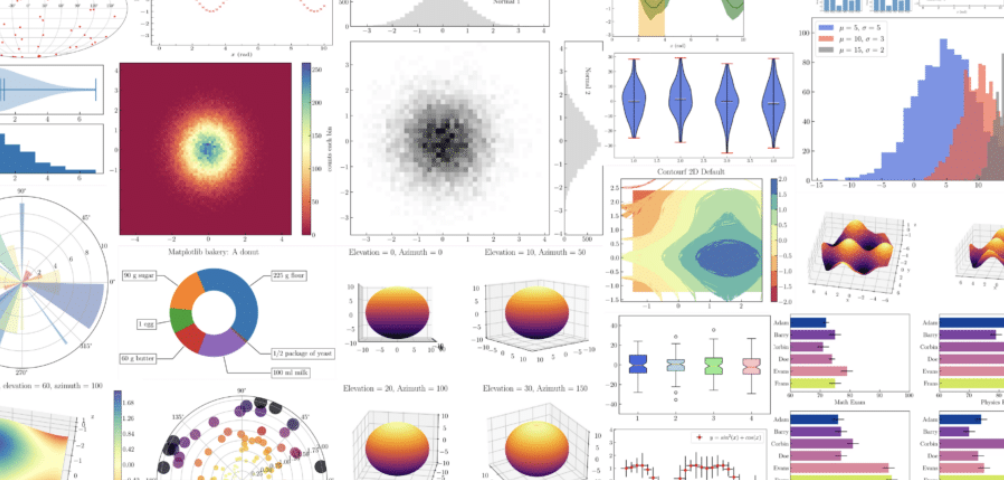

具体效果如下:

在红毯上,布莱克·莱弗利小声说:“好紧张”。即使她在笑,肉眼很难分辨唇语,但AI却能识别出来。

侃爷虽然只露出一排白牙,但他的唇语也被轻松破解。

看完后,网友们纷纷发表评论,大开脑洞:

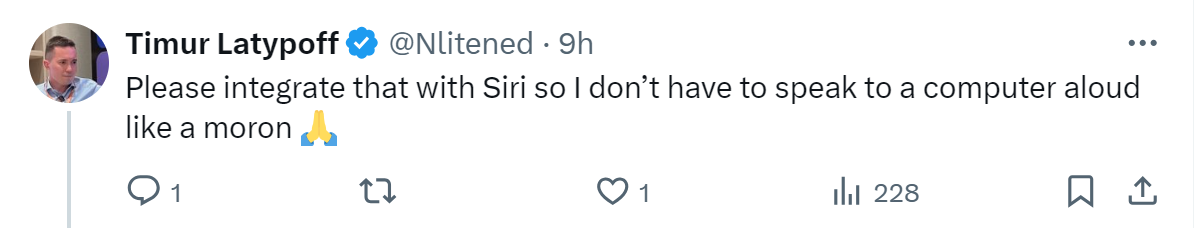

求“联名”型网友: “快把它和Siri结合一下吧!这样我就不用像小傻子一样对着电脑大喊了!”

测评型网友: “我想用它试试‘座机画质’的视频!”

担心安全型网友: “我有点害怕,我想戴口罩了。(呜呜)”

有人尝试了奥特曼在斯坦福的访谈视频,将生成的文本与原始对话对照,内容完美契合。

面对表情较多的老马,Readtheirlips的表现依然稳定。

但是,当视频中的人物不是全程正脸时,如爱比划的小扎,Readtheirlips就直接显示错误。

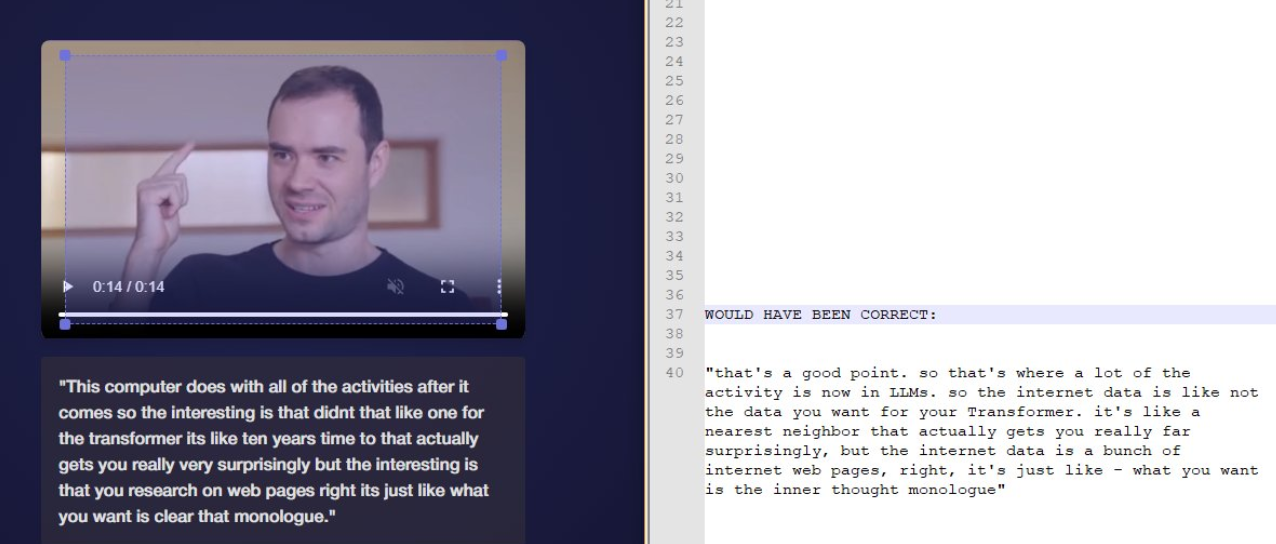

当主角换成卡帕西后,由于他说话速度过快,生成的文本中出现了识别错误。(左侧为Readtheirlips生成的结果,右侧为文字处理软件生成的结果)

最后,我们尝试上传了一段16分钟的视频,但Readtheirlips直接显示错误,无法识别内容。

总结如下:

- Readtheirlips能够识别的视频时间长度大约在一分钟左右。

- 如其说明所示,如果视频中的人物未能正面对准镜头,模型将难以给出正确的答案。

- 对于语速过快的视频内容,Readtheirlips只能识别部分内容。

针对上述问题,团队成员回应道:

- “是的,这部分我们尚未研究,但我们会尽快解决这个问题。”

关于视频时长的限制,他们的解释如下:

- “目前仅支持三分钟以内的视频,但未来我们会逐步提高这一限制。”

在观看完实际测试视频后,让我们了解一下Readtheirlips的工作原理。具体来说,它如何读取人类的唇语:

- 首先,研究团队利用大量带有标签的数据(已知的嘴唇动作及其对应的文字内容)来训练模型。

- 用户需上传一段包含说话者面部特写(特别是嘴部动作)的视频。

然后,模型会对视频中的嘴部运动进行分析:首先通过面部检测确定嘴唇的位置,接着提取嘴唇的几何特征(如形状、开合程度、运动轨迹等),最后分析嘴唇在说话过程中的动态变化(包括速度、方向和形状的变化)。随后,模型将提取到的嘴唇特征与训练数据中的特征进行匹配,以识别视频中人物所说的内容。

将识别出的单词或短语组合成完整的句子,并进行上下文理解,确保语法和语义的正确性。

最终,将识别出的内容输出为文本形式。

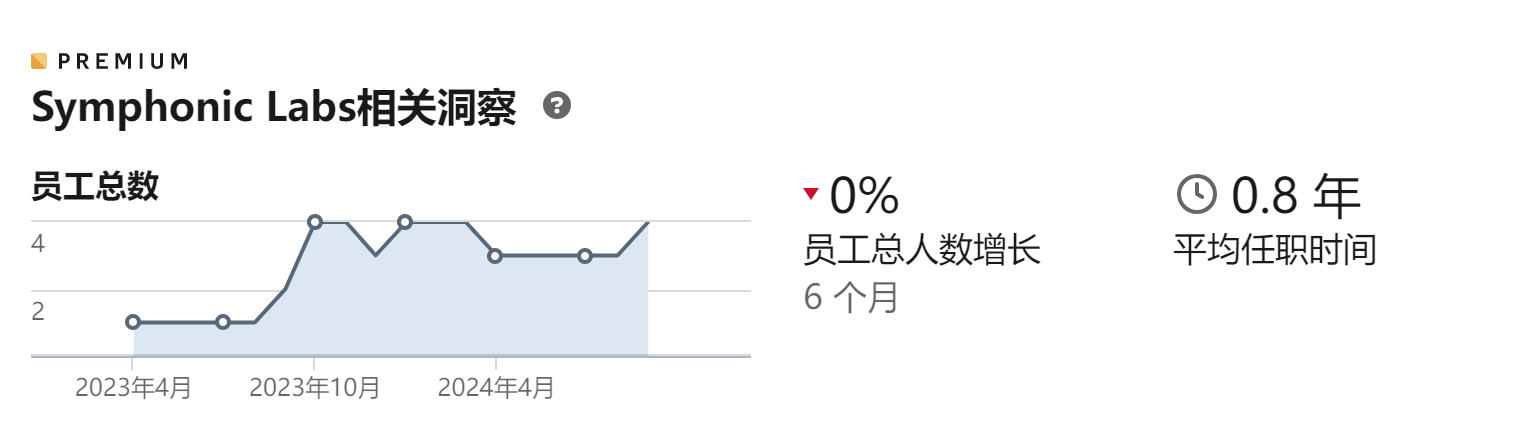

Readtheirlips的开发团队Symphonic Labs是一家初创公司。

根据领英上的信息,该公司在今年4月刚刚成立,目前员工人数不到10人。

他们之前还研发过一款通过读取唇语实现实时文本转录的软件Symphonic。

两款软件的试玩链接均已附上,感兴趣的朋友们可以去尝试一下。

“迄今最复杂的结构”

还能识别眨眼的动作。

你一个靠可乐发家的,怎么用AI种土豆了???

VR/AR等元宇宙相关技术持续上升

斯坦福教授历时十年进行训练

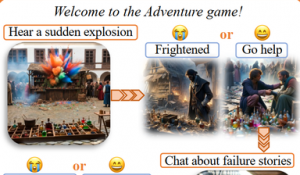

定制化生成互动叙事游戏