阿里国际最新发布了开源多模态模型Ovis,其多模态能力得到了进一步提升。

编辑日期:2024年09月20日

超越行业顶尖大模型

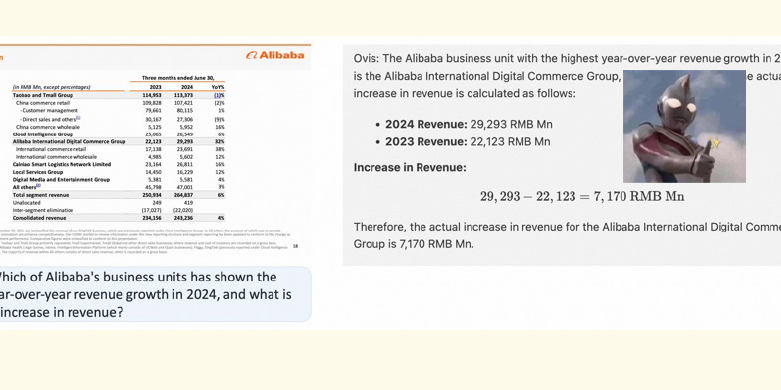

只需看一眼菜品图就能知道如何烹饪、能够为植物诊断疾病、准确地将手写英文翻译成中文、还能精确分析财务报告数据……多模态能力再次实现重大提升!今天,阿里国际AI团队发布了一款全新的多模态大模型Ovis,在图像理解任务上不断突破极限,在多个具体子任务中均达到了SOTA(最新技术)水平。

多模态大模型能够处理和理解多种不同类型的数据输入,例如文本和图像。与专注于处理和生成文本数据的大语言模型(LLMs)相比,多模态大模型还能处理非文本数据,如图像等。

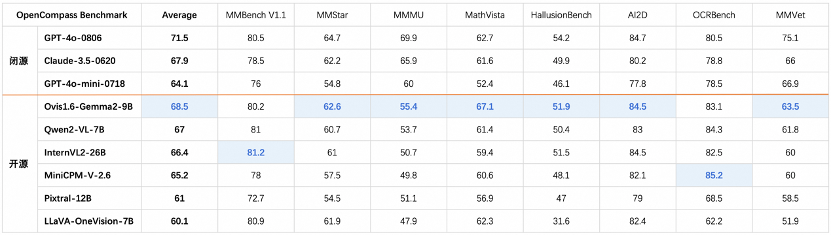

根据多模态权威综合评测平台OpenCompass的数据,Ovis 1.6-Gemma2-9B在30B参数以下的模型中取得了综合排名第一,超越了MiniCPM-V-2.6等业内优秀的多模态大模型。

图:Ovis在OpenCompass上的测评数据情况

据介绍,Ovis在数学推理问答、物体识别、文本提取和复杂任务决策等方面表现出色。例如,Ovis可以准确回答数学问题,识别花卉品种,支持多种语言的文本提取,甚至能够识别手写字体和复杂的数学公式。

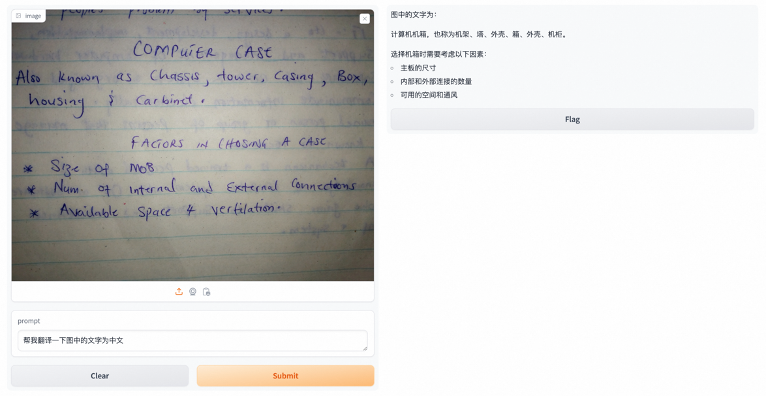

案例1:Ovis对手写文案的识别及翻译能力

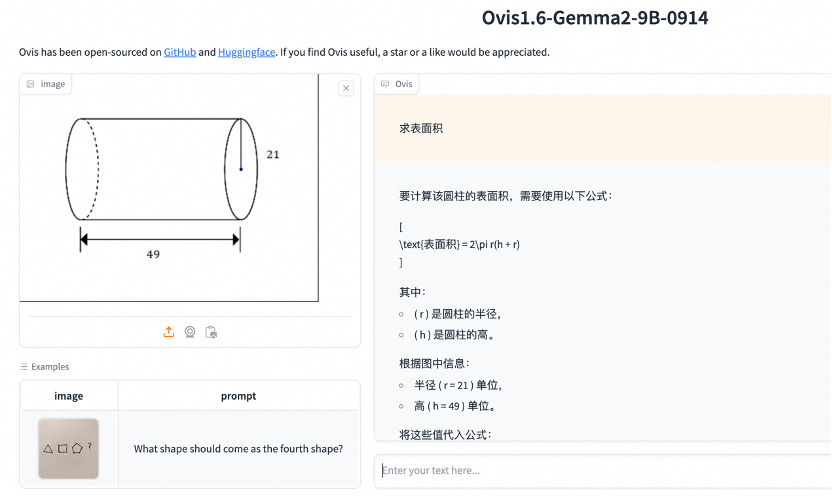

案例2:Ovis对复杂数学公式的处理能力

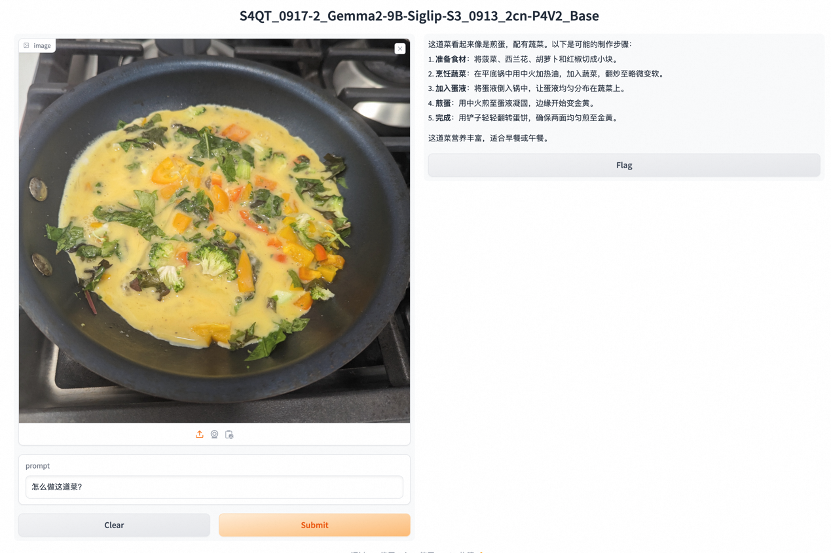

案例3:Ovis通过对图片的识别处理能够给出菜谱

具体来说,Ovis模型具有五大优势:

-

创新架构设计:引入了可学习的视觉嵌入词表,这是首次将连续的视觉特征转化为概率化的视觉token,并通过视觉嵌入词表进行加权生成结构化的视觉嵌入,从而克服了大多数多模态语言模型(MLLM)中MLP连接器架构的局限性,显著提升了多模态任务的表现。

-

高分图像处理:采用动态子图方案,支持处理极端长宽比的图像,并且兼容高分辨率图像,展现出卓越的图像理解能力。

-

全面数据优化:涵盖多个方向的数据集,包括Caption、VQA、OCR、Table和Chart等多个多模态数据方向,显著提升了多模态问答和指令跟随等任务的表现。

-

卓越模型性能:Ovis在多项指标上表现出色。在多模态权威综合评测平台Opencompass上,Ovis1.6-Gemma2-9B在30B参数以下的模型中取得了综合排名第一的成绩,超越了Qwen2-VL-7B、MiniCPM-V-2.6等模型。特别是在数学问答方面,其表现接近于70B参数的模型;在幻觉任务中,Ovis-1.6的幻觉现象和错误率显著低于同级别模型,展示了更高的生成文本质量和准确性。

-

全部开源可商用:Ovis系列模型采用Apache 2.0许可证。Ovis 1.0和1.5的数据、模型以及训练和推理代码均已完全开源并可复现。Ovis1.6系列中的Ovis1.6-Gemma2-9B也已开源权重。

在AI领域,多模态大模型的应用场景非常广泛,包括但不限于自动驾驶、医疗诊断、视频内容理解、图像描述生成和视觉问答等。例如,在自动驾驶领域,多模态大模型可以整合来自摄像头、雷达和激光雷达的数据,实现更精准的环境感知和决策。由于多模态大模型能够学习如何联合理解和生成跨多种模式的信息,因此也被视为迈向通用人工智能的重要一步。

根据先前的媒体报道,阿里国际于去年成立了一支AI团队。截至目前,该团队已在超过40个电商场景中测试了AI技术,涵盖了跨境电商的整个流程,包括商品图文处理、营销、搜索、广告投放、SEO、客户服务、退款处理以及店铺装修等多个方面。其中,许多应用场景都是基于Ovis模型开发的,并已帮助了50万家中小企业优化了1亿种商品的信息。据透露,商家对于AI的需求持续增长,最近半年的数据表明,商家每两个月对AI的调用频率就会翻一番。

以下是一些相关链接: - 论文arXiv: https://arxiv.org/abs/2405.20797 - Github: https://github.com/AIDC-AI/Ovis - Huggingface: https://huggingface.co/AIDC-AI/Ovis1.6-Gemma2-9B - Demo: https://huggingface.co/spaces/AIDC-AI/Ovis1.6-Gemma2-9B

此外,还推出了全新的AI采购智能体。

大规模模型正在重构一切,跨境电商行业已经率先感受到了这一变化。