90270亿参数谷歌发布gemma2开源ai模型性能力压同级单a100h100gpu可运行

与初代相比,Gemma 2大语言模型展现了显著的性能飞跃,在推理能力上更加强大,效率也实现了大幅提升,并且在确保安全性的领域取得了重要突破。

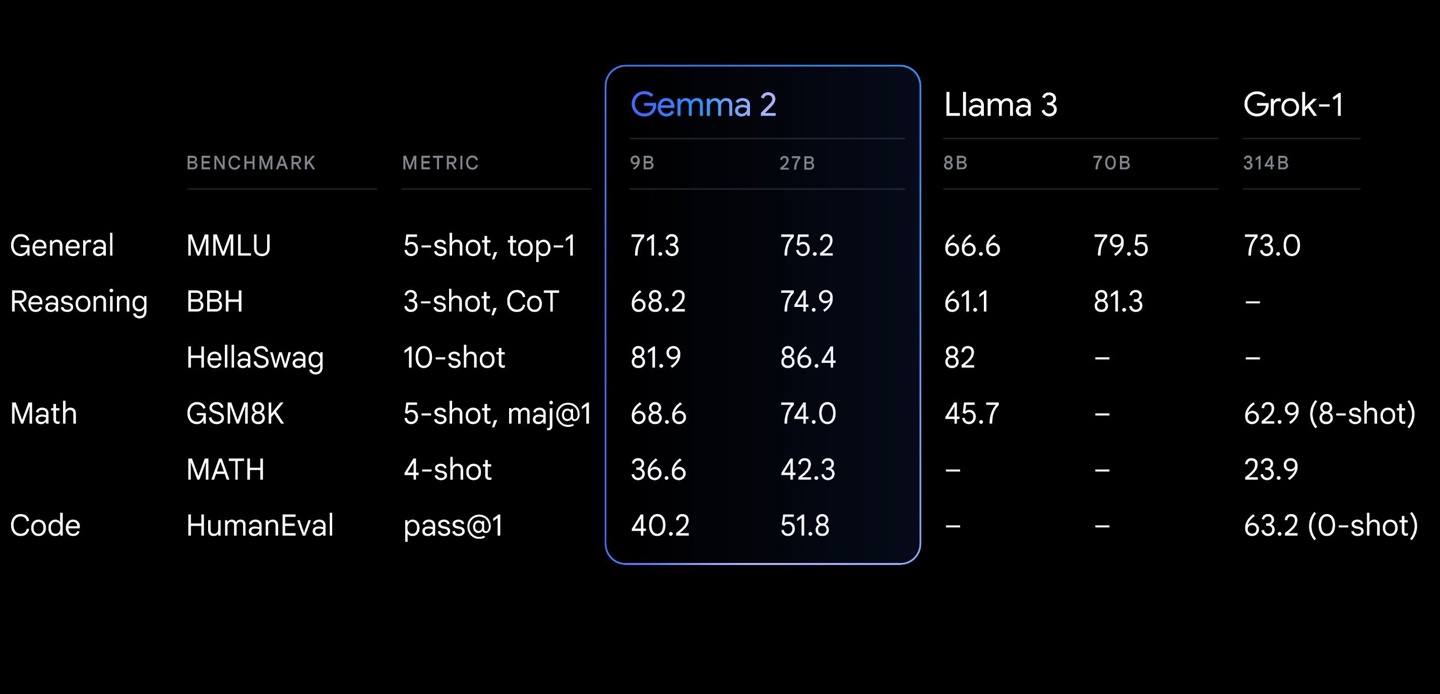

根据谷歌发布的新闻稿内容,Gemma 2-27B 模型展现出了与目前市场上两倍于其规模的主流模型相匹敌的卓越性能。更为显著的是,这一高性能表现仅需借助单一的 NVIDIA H100 Tensor Core GPU 或 TPU 主机即可实现,大幅度削减了在实际部署过程中的成本开支。

相较于Llama 3 8B模型及同类规模的其他开源模型,Gemma 2-9B展现出更优越的性能。展望未来数月,谷歌蓄势待发,即将推出专为智能手机AI应用量身定制的Gemma 2模型,其参数量达到26亿,旨在进一步优化移动设备上的智能体验。

谷歌宣布,Gemma 2经历了全面的架构革新,旨在达成巅峰性能与推理效率。以下是Gemma 2的核心特性概括:

版本27B在相同规模等级中展现了无与伦比的性能优势,其竞争力甚至超越了那些体积两倍于它的对手。而9B版本同样在同类产品中占据性能巅峰,不仅优于Llama 3 8B,还领先于所有其他相似规模的开源模型。

重写后的结果为:

Gemma 2 模型版本 27B 能够在顶尖硬件平台上展现出卓越的推理性能,包括单一的谷歌云 TPU 主机环境,以及英伟达最先进的A100 80GB Tensor Core GPU和H100 Tensor Core GPU,均支持全精度运算。这一优化不仅维持了服务的高速运行状态,还显著削减了成本开支,为AI技术的实际应用铺设了一条更为通畅且经济的道路,极大地促进了人工智能部署的可及性和财务可行性。

Gemma 2 进行了全面优化升级,确保在广泛的硬件配置上都能飞速运行,无论是高性能的游戏笔记本、顶级台式机,还是云端部署环境,皆能展现出令人惊叹的运行效率。

探索Google AI Studio中Gemma 2的全精度潜能,或借助针对CPU优化的Gemma.cpp量化版以释放本地硬件的卓越性能。此外,您还可以在配备有高性能NVIDIA RTX及GeForce RTX系列显卡的个人电脑上,通过Hugging Face Transformers平台进一步体验其非凡能力。

大家都在看

Python小白教程:点击学习

数据分析练习题:点击学习

AI资料下载:点击下载

大家在看